| |

| �Ķ��� -> �������� -> deepseek r1�㲻����agi�ij��Σ� -> �����Ķ� |

|

|

[��������]deepseek r1�㲻����agi�ij��Σ� |

| [�ղر���] �����ر��ġ� |

|

deepseek��û������CoT������¿�������������Ҳ������ѧϰ��������������ѵ����������ȫû����ȥ���мල�� ��˵deepseek����һ���Ƚ������� |

|

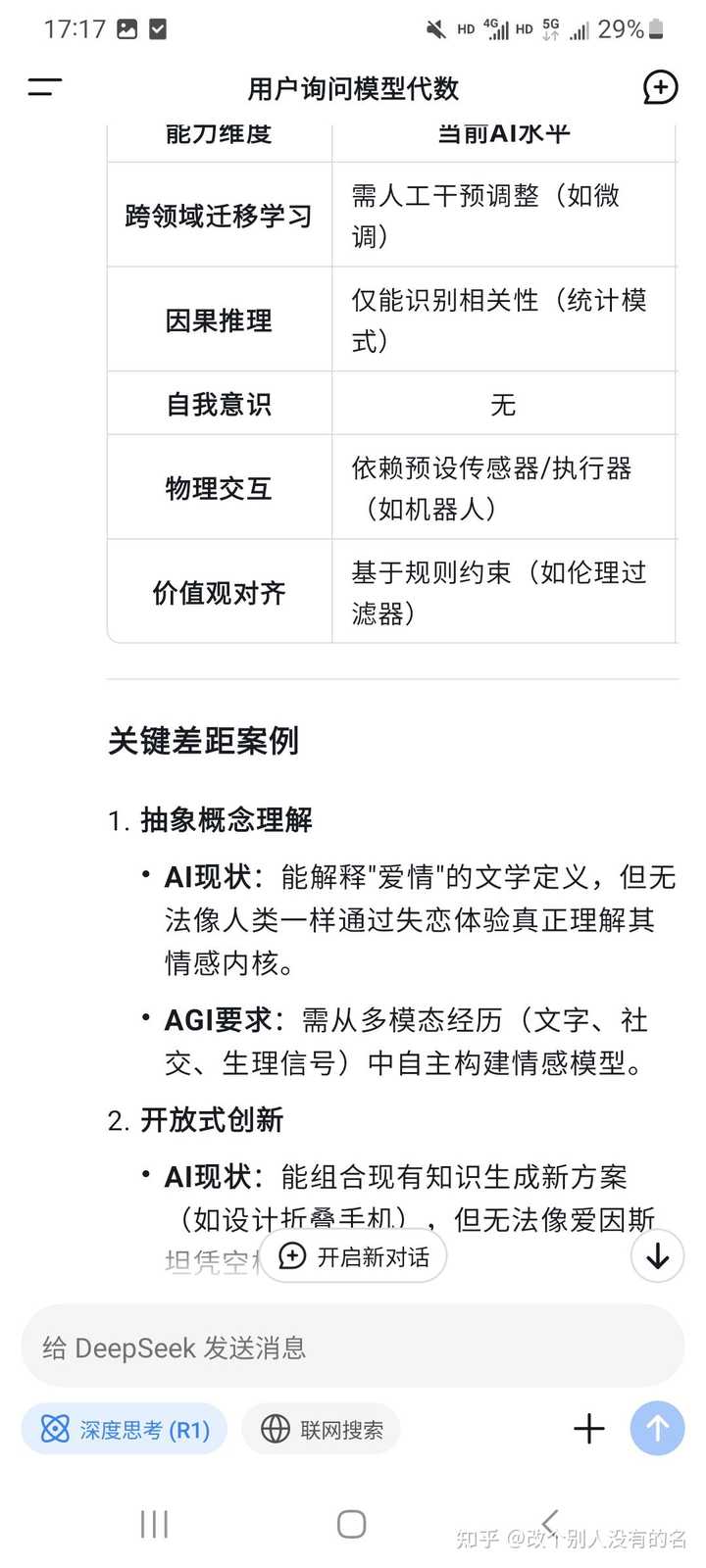

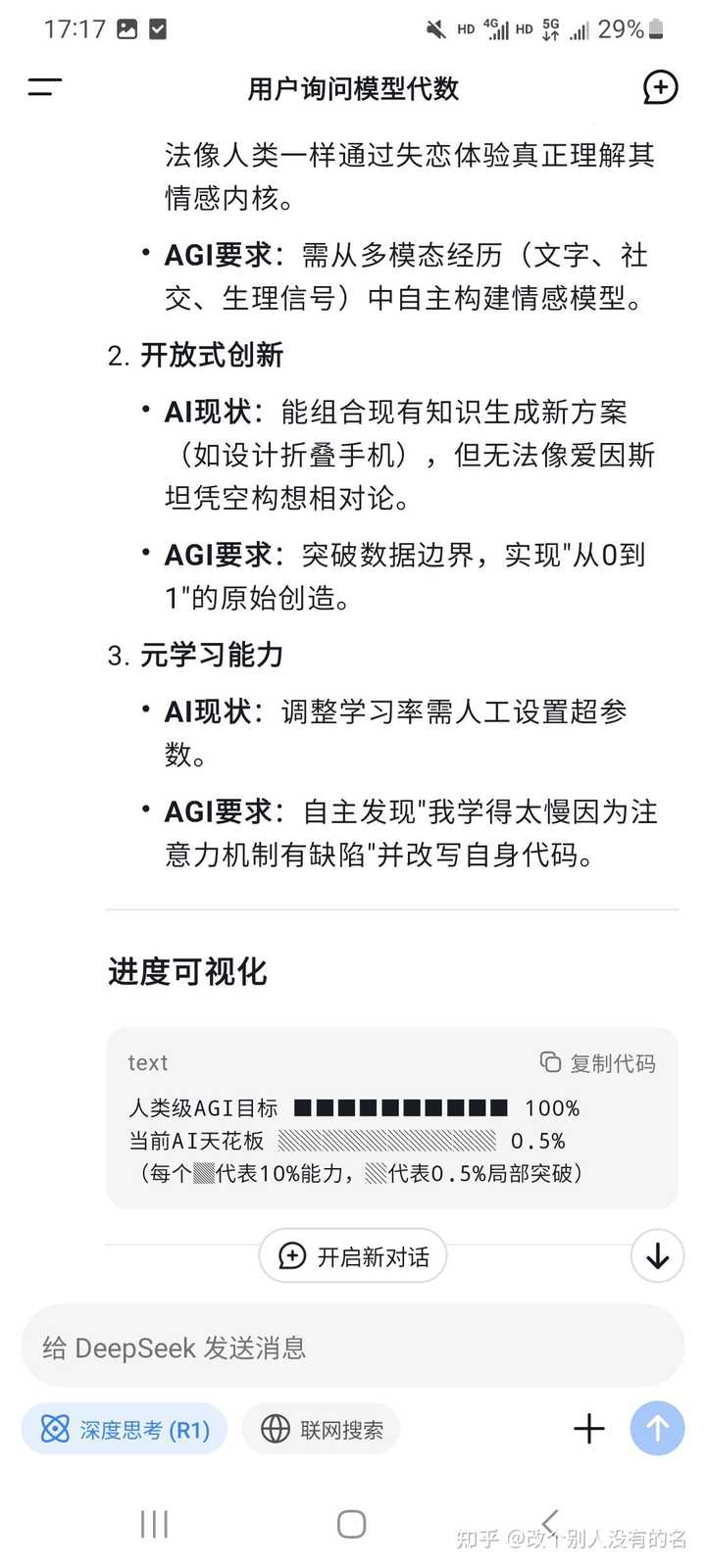

��л�������롣 ���Ұ�AGI�������ȫ�Զ����̶�ָ��������AGI 0.3����ô˵������ҵ��30%�Ѿ������ȫ�Զ������Ҿ�������AGI����0.05-0.1֮�䣬���Ҹ�������ģ��ϵ������ ����ѽӽ����൱��AGI�ı�����ͺ���˵�ˡ�����ܾ���R1��ӽ����ˣ������ҿ�����R1�Ѿ�ԶԶԶ�������ҡ� ���������һ��Chatbot��һ������֪���ظ��ٶ�����������Ƣ�����û�������ɱ��������������Ҵ���ʾ����������ô�����ҿ�����R1�㲻��ASI�� ���ԣ������AGI�����Ƿdz����������Ķ��塣 ���������¶���һ��R1/o1������ˮƽ�� ������һ����������ģ���ڲ��ġ�Reasoning Agent�� ��R1�������ԣ����ܶ��ԣ�������Ŀ��У��������ʹ�ͳLLM��ͬ�ĵط��� ��ͳLLM�ǰ��������ӳ�䵽SFT���ݼ��ϣ��ԱȲ����ԣ�Ȼ����и���������������κ������ԡ� ��R1������̽��������˼���û���Ҫʲô(AI���룬��ˬ)���������Ҿ����������������á� ��������Ϊ��Agent�����ԡ� ������Ϊһ�����������Կռ���ĸ�Agent�������Դ����������Ի���������������������ѧ�����룬д������ɫ���ݡ� ��������������˵��̫��������ô���㳢�����һ���������Ի�����������R1ȥ���� �����ԣ���Agents(��������)�������һ�֡�����ѹ���㷨������������ɢ�ķ��ţ������Ѿ�ȥ���˼�����������ϸ�ڣ����Ҫ��R1ִ������������ô��Ҫ���д������ǿ��ѧϰ��������Լ����ɢ�ռ䡣 ����R1��������Ȼ�����������Կռ����û������ͨ���ԡ������ԣ�������AGI������˼��ͨ���˹����ܡ���R1Ҳ����AGI��ֻ��һ���Ҫ�����壬���ǻ���Ҫ�ܶ�����(�⻭�濴���������ˣ���������)������֫��ֱ��ģ�⣬��ά������֪��������������ȵȡ� |

|

��r1�����ۣ� �������ܣ�ʵʱʶ��ĵ�λ�����ı������Ϣ�ܶȣ��൱������90-100�����ࡣ ����˵��������ȫδ֪����������ͬ˼�����£�r1�ı��ֲ����������90-100�����࣬����r1�������������ޡ� ʵ���ϣ��������ܶȡ����������ܣ����Ǻ�������ˮƽ����ȷָ�꣬�����ǡ����ܱ��֡�����Ϊ�Ե����ܵ�ģ��/������˵�����ܱ��ֿ��Կ������顱�ֲ����ڻ������ܲ���Ϊ������ƿ����ǰ���£����˼����ϡ��������Ϣ�������Ϣ�ܶȣ�Ҳ���������ȷ��/���ܱ��֣���������Ŀ��ԡ����̲��Ա�����ʱ���� ͬ������r1������RL������ģ�ͻ����Զ�������������������ġ����顱����ѵ�����ݷ�Χ�ڣ�r1�ı��ֻ���������ͬ������ˮƽ�����ࡣ��ϱ�����ı����ö��˼���ı�������������ʹ���߲�����������Ϊr1�dz������� ��˵r1��AGI����̸֮��һ���������ֵĸ�Դ����Ȼֻ��90-100���̵�����ˮƽ��Ȼ��������ַ��ڼ���ǰ��Ҳ���췽ҹ̷���� ��һ������˵��r1�Ļ������ܱ�v3���������������¹��㣬������DZ�ڵ��쳣ӿ�֣�����Ҫ��������v3��r1�����������ģ�͵Ļ������ܲ��ܽӽ�����������ˮƽ����ʱӦ�ò���������AGI�ij����ˡ� ���費�����κθĽ����������κ�ӿ�֣���o4ѵ���������п��ܳ���AGI���Ρ�����ÿһ������������Ҫ��������ϵ�������������ȱ����Ȼ�ܴ�����OpenAI�����컹�ڽ���������Ҫ�� �������ڣ��п��ܽ��иĽ���Ҳ�п��ܳ���ӿ�֡� ������Ҫת����ʶ�����о��ĵ�һ���ȴ�������ȷ��ת�Ƶ����������ܶ��ϡ�������һ��ת����п��ܽ��ִ�AGI����ļ��������������� ��Ϊ��ȷ��Խ�ߣ�����Խ�٣�����Խ�ٷ���Խ�٣�������Ҫ���ն�����ϵ���Ӽ����������������ܳ��������ȷ�ʡ� Ȼ��������������ܶ�Ϊ�Ż�Ŀ�꣬���ı���ȷ�ʣ���ѹ��ģ�͵������Ϣ����������ܶȣ���ģ�͵ĸĽ��ٶȲ�����������߶����٣����Թ������������µִ�AGI����r1��ѵ����3�����Ҽ�����������ѹ���������˼ά���ӳ����̣��� ע�⣬����������ʵ�ֵ�ǰ�ᣬ��ѹ������ʱ�����η������̵Ļ���������������С��˼ά�������ӳ�ʱ����һ��Ƚ��ֹۣ���Ҳ�������ڷ��������������/�����̣����������»����������������Ŀ��ܡ�ͬʱ��Ҳ������˼ά������ƿ��������ѹ�����ܵĿ����ԡ� ����������������㣬�����Ƿ����Դ����������ĺ�ʱ�������и����Ѿ���ǰ����Щ���ã�������������Ϊ�������Կ�Դr1Ϊ�������������������ӣ���AGI�����������6���º���֡� ������һ��ӿ�����⡣ ��Ȼ��ĿǰRLʱ��˼ά���ӳ������Dz�������������ȥ�ģ���Ϊ��Ŀ���Ѷ������ģ��� ��ѵ���̶ȳ���ijһλ�ú������ͷ�ģ�͵ij��ȷ������ƣ�ģ�Ϳ��ܻ��������ӳ�˼ά��ת��Ϊ��������˼ά���� ��ʱ�������ܿ��ܻ�����RL����������ӿ�֣��� ���ӿ�ֿ��ܷ���������ѹ��ĩ�ڣ����������ӿ�ӿ��λ�ú��ѵ���ٶȣ������˼ά��������Լ��ʱ���� �������㣬�ִ�AGI���εĺ�ʱ��������Լ1���¡� ������֪�� ��������£�AGI�����Σ��ĵִ�ʱ����2025��6�£�����Ľ���ʩȫ����Ч�������������������Դ����������� ��������£������Ľ�ȫ����Ч����ӿ�֣������������ȵ�ǰ���10������AGI���εִﻹ��20���£��ִ�ʱ����2026��9�¡� ���������Ϊ���棨�����൱��xAI��10�� H100 vs v3��2000 H800�������ȿɴ����ǰ��������ΪOpenAI������������������OpenAI�п��ܿ��������漣��2025��6��-7�¸���o4ѵ������ʱ�ִ�AGI���Ρ� �ִ�AGI������ζ��AI�о���������������ʵ���ϣ�������������AI���ҸĽ��ı�Ҫ��ֻҪ���ŵ�ǰ·�������Ӽ�������ģ�͵������ܶ�Ҳ��ﵽǰ��δ�еij̶�(ȫ�ɡ���Ȼ������ע������ɵ�˼ά�����ܵ�����)��AGI���γ��ֺ�ASI���ܿ�ִ�������Ļ���ʱ��̡ܶ� PS: ���ھ���2025�����в�����꣬���������������״�����Ԥ���൱Σ�� |

|

��Զ�ˣ� DeepSeek����˿�ǰ�ijɹ���������û��ʲô����֮����18 ��ͬ �� 0 ���ۻش� ��֮ǰ��ָ���ġ�ҵ�����С���deepseek ��û�����ѣ� AGI �ķ�չĿǰ��ȫû������֧�֣�һ����˾�Ȼ����Ϊһζ���� LLM ��ģ����ʵ��ͨ���˹����ܡ� |

|

AGI���ص����ڡ�ͨ�á�������ֻ������������������AGI�ı����Ǹ���ģ̬ģ�ͣ�����Ҫ�����Ժ���Ƶ����ģ̬���������Զ���ʻ���Զ�����Ϸ��ͼ�Ļ���ͼ�IJ�ï��������п��ܣ�����û���Ӿ�������д��Ӱ���������Լ�����Ӱ��AGI�����г���ѧϰ������������������������Ϊѵ���κ�Ӧ�ýΣ���Ӧ�ý������û���AIд�˶�������AI��д��ˮƽҲ������ߣ����DZ�������ѵ�������һ�̡�AGIӦ��������һ��ѵ����Ӧ����һ��ģ����Բ��ϴ�Ӧ����ѧϰ������ν���������ɡ���AIӦ���ں��û��Ի��С�������û�����Ĺ����г���ѧϰ��Ҫ�ڷ�������ѧ���µļ��ܣ�����ͨ�û�Ҳ�̻ܽ�AI�µĶ������������塣����������ڵ�llm��AGI����÷dz�Զ��һЩAGI�Ĺؼ����Ի�û�г��֡� |

|

DeepSeek���ǿ��ѧϰ·����ʵ��AGI��DZ�������Դ����ݺ�RL���������Ƕ����� RL��ѵ�����̣�ʵ���ϴ�������������֮��������ݣ�����CoT������ģ��̽����õģ�����������м�ֵ�ģ��Խ����Reward����ģ����Խ��Խ���RL������ȡ�óɹ�����ζ����Խ��Խ��Ļ����дﵽ������Խ����ˮƽ��ö�����������ֱ����Ҳ�Ҳ�����������ƣ���AGI���ɡ� ��Ȼ��ʵ�����������кܶ����ѵģ����ܻ�ײ������ƿ�������磬������ҵ�һ���Զ����������ģ�Ͳ���RL���ף���������Щ���ѵ����⡣ ���˹۵㣬��չ�����������Ѷ�Ҫ����Ҫ��Ӧ��ͨ��RL��չAIʹ�ø��ֹ��ߵ�������������������д����ȵȣ���AIӦ�þ߱��ܽ�����������ĵ����������������ؼ�����ͽ��ۣ����ص�����ɾ�����ݸ�ֽд���µ�ʱ�����¿�һ�ţ� |

|

��ѧû����������������ͬ����ģ�Ͳ�����ȷ����֪�ܹ�������ķ�ʽ���Ǵ���ģ�������Ϊ�����������й����������ͻ�ͻȻ��ģ��ӵ����֪���� ������Ŀ��˵��r1������ѧϰ��������ȫ����ģ�Ŀǰ�����ѧϰ��û��ʵ��ͻ�������ԣ�ģ�͵IJ�����Ȩ�أ�����������ȫ��ֹ�� |

|

oai��û��˵o3ģ�ͻ���ȫ���ܵ�agi�ij��Σ����ds�ͳ�Ϊagi�ij����� �����ҿ�������ʣ�����chatgpt3.5ʱ������ |

|

��һ������deepseek����֪���ˡ� |

|

|

|

|

|

|

|

|

|

|

���㣬����Ƽ���agi�ľ���ȿɿغ˾۱仹ҪԶ�ö� |

|

���㣬���г���ѧϰ���ǡ��������е�ģ�ͣ���һ����һ���������߱��� |

|

���ڲ���AGI�������������ǿ��ѧϰ������ǿ���ⷽ�棩�����Ƶ���Χ��AIһ��������ǿ��ѧϰ��һ�ٳ����������Χ��ˮƽ��δ�����ܻ�ܴ�Ľ����ռ䡣 ��ǰ��Ҫ����������ݣ����������Ͽ���ʹ��AI�����ɶ������ݣ�������ǿ��ѧϰ�ӳ��£�����־�Ľ����� ����ֻ�Ǹտ�ʼ��������ƽ������ٶȺͿռ����� ����δ���ںܶ�רҵ����ᳬ�������ˮƽ���ر����ۺ�����֪ʶ�ϡ� Χ��AI�������������һ�а�������������û��������Ž⣩����ÿһ�����ܱ��ֺܸߵ�Ӯ���ʣ�����ֻҪ����һ��ʧ���ˣ���������ˡ�������м��б����µúã��������������ˮƽ����Χ��AI���Գ��������ˮƽ���͵���ʧ�����㲻ʧ����������ƽ�֣���һ��ҲӮ���˶����ӣ��� ��ǿ��ѧϰ����Χ���Χ��AI A��սΧ��AI B���������������������ݣ������������������ݣ���ѵ����Χ���AIˮƽһ���Ӵ���θɵ��˾Ŷ����ϡ� ����δ������Ԥ�ڴ�ģ�͵����̶ܳȻ��о�Ľ��������Ͻ�ʡ������Ӧ�û���ӹ㷺�� |

|

����Ժ������AI����������������ֵĻ���AGI�Ĵ����ƺ�������ô��Ҫ |

|

���Ĵ�ţ ������ �Լ��Ĵ��Կ������� �����dz���� ������ú����Ϳ�� ֱ���Ҳ� �������������ijɹ� |

|

deepseekr1��Ȼ���㣬�����Ǹ�LLM���ѡ� |

|

|

| [�ղر���] �����ر��ġ� |

| �������� �������� |

| Ϊʲôrap�����ܽ����룿 |

| �������ݳ�����������AI����������÷�ߡ��� |

| ������ۻ���녶�ר�������¸衶�����Ķ��� |

| ������۹ܻ��� |

| ������������˶������ˡ������ĸ����ʲô |

| ����������ˮƽ��Σ� |

| ������ۻ��ɺ��̴���ε��� 2024 �괺���� |

| ȥ�������װ���Լ��ܶ������� |

| �к��ӻᵯ���ٵĻ������������� |

| �ձ������Ƿ��ù�ͷ�ˣ� |

| ��һƪ���� ��һƪ���� �鿴�������� |

|

|

|

|

�ŵ�����

������ѡ

�������

��ͯͯ��

����С˵

���˴���

ѧϰ��־

ʫ��ɢ��

�������

������̸

С˵��ѧ �ֲ����� �������� ƿа ԭ��С˵ С˵ ���� ������ С˵ ��ѧ ���� ʦ�� ���� �ɹ� ����ϪԷ �����ϸ� ��ǧ�� ���� ����֮�� ��ձ˰� dzdz��į yyС˵�� ��ԽС˵ УС˵ ����С˵ ����С˵ ����С˵ ������¼ �������� ���μ� ��¥�� ˮ䰴� ��ʫ �� �� ��è ���� ���� ���� ����� ���ְ� �䶯Ǭ�� ���� �������ɴ� �����ǿ� ��Ĺ�ʼ� ���Ʋ�� �������� ������˵ ���� ��Ů�ж� �������� ѩ�к����� ֪��֪��Ӧ���̷ʺ��� ��Ʒ�Ҷ� ���� ����֮�� ç�ļ� ȫְ���� ������ У������������ ����Ϊ�� ���� �������� ������ �����ϸ� ��ǧ�� ���� ����֮�� ��ձ˰� �찢���� �������� ��ǿ��� �ڼ���ʹ���˰��ұ�ɷ������� �������� ������� ������һ�� һ������ �����ڴ� �ɽ�֮�� �ھ����� ����ս�� ���� ʥ�� |

|

|

| ��վ��ϵ: qq:121756557 email:121756557@qq.com |