| |

|

| 阅读网 -> 教育信息 -> 复旦某个教授:我们与OpenAI的差距正在拉大。你怎么看? -> 正文阅读 |

|

|

[教育信息]复旦某个教授:我们与OpenAI的差距正在拉大。你怎么看? |

| [收藏本文] 【下载本文】 |

|

近日复旦教授肖仰华说:“我们的文化中,聪明人太多,总想抄近路。有时候就是要坚持,要笨一点,才能做出真正的大杀器。我们与OpenAI的差距正在拉大,不是… |

|

十一月初刚出来的纪录短片,可以看看: Ilya Sutskever(伊利亚・苏茨克弗):塑造世界的AI科学家?b23.tv/uV5n8CU 思考的问题都不在一个维度上,谈不上差距,因为完全不可测度啊… 另外我强烈推荐大家听一下这个播客 AI技术爆发的背后:安全、伦理与责任,戴雨森采访青年学者符尧?www.xiaoyuzhoufm.com/episode/65600fcb9f440f54439c3877 |

|

|

符尧非说的常好,面对这种新问题,中国研究机构瞬间和MIT站在同一起跑线,明明是很好的机会,结果大家仍然是在盯着OpenAI的屁股…那又能走多远呢? 播客里还有很多和对齐有关的科普,强烈推荐 |

|

看到答主 @刘斯坦 提到了关于原OpenAI首席科学家IIya的个人纪录片,我就去自己看了看。 |

|

|

一个小插曲,这个纪录片的部分内容是在2018年就拍摄好的,可以看到IIya这时候的头发还是有不少的。 而现在的IIya头发是这样的,可想而知从GPT2到GPT4的过程真的很费头发。 |

|

|

这段纪录片有11分钟多一点儿。 我就不把所有的内容拿出来了,就总结下主要内容。 主要就是IIya对于AI的观点。 |

|

|

第一,AI的潜力以及面临的挑战 人工智能(AI)正成为一种重要的力量,因为它有望解决我们今天面临的诸多问题。AI的应用范围广泛,从解决就业问题到治疗疾病,再到消除贫困,它的潜力无穷。然而,人工智能的发展同样伴随着新的挑战。例如,假新闻的问题将变得更加严重,网络攻击将更加极端,我们甚至可能面临全自动的人工智能武器。更为深远的担忧是,AI可能导致无限稳定的独裁统治的出现。目前,超过1300名科技行业领袖、研究人员等正在呼吁暂停AI的发展,以深入考虑这些风险。 第二,AI与人类目标的一致性 |

|

|

|

|

|

|

|

|

|

|

|

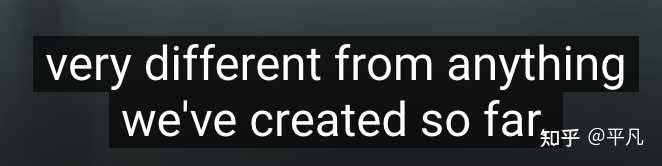

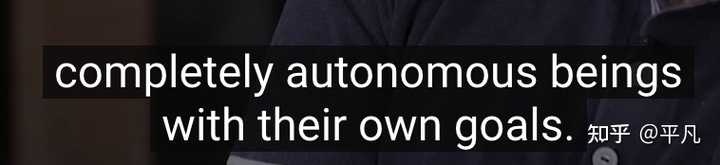

科学家们一直被指责在“扮演上帝”,而当前的AI发展似乎正在将这种指责变为现实。我们正在创造出与以往截然不同的东西――完全自主的实体,具有自己的目标和意志。 |

|

|

随着这些实体变得比人类更加智能,确保它们的目标与人类目标一致变得至关重要。这种思考方式激励着我们去探索基础问题,比如学习、经验和思考的本质,以及大脑是如何工作的。 第三,技术与生物进化的相似性 技术,特别是人工智能,与生物进化有许多相似之处。就像我们通过自然选择理解生物体的复杂性一样,我们现在也正在通过机器学习――尤其是深度学习――来理解技术的发展。在深度学习中,一个简单的规则不断从数据中提取信息并应用于模型,从而将数据的复杂性转化为模型的复杂性。这导致了非常复杂的模型,我们尚未完全理解其工作原理,但是创造它的算法却异常简单。 Chat GPT可能是你听说过的AI的一个例子。它被形容为暴雨前的第一滴雨点,标志着一个关键的时刻。据微软研究所的一项最新研究表明,GPT-4已在某些方面超越了人类,它被认为是一个早期但尚不完整的人工通用智能(AGI)系统。AGI是一个能够完成任何人类能做的工作或任务的计算机系统,但执行得更好。 第四,通用人工智能(AGI)的潜在影响 虽然AGI实现的时间尚不可知,但我们必须认真对待它的可能性。最初的AGI可能是巨大的数据中心,内部装满了并行工作的专用神经网络处理器,消耗的能源可能相当于数百万家庭。这些高度智能的系统很可能对社会产生深远的影响。我们必须确保这些系统的信念和愿望与人类的最佳利益保持一致,否则它们可能像人类对待动物一样对待我们,当建设对人类重要的设施时,不会考虑其他生命。 第五,国际合作的必要性 许多机器学习专家对人工通用智能的发展持怀疑态度,认为它可能永远不会实现,或者至少在可预见的未来不会实现。然而,随着AI用于神经网络的计算机速度可能在未来几年内提高10万倍,我们可能很快就会看到AGI的发展。在此背景下,国际合作至关重要,以确保AGI的发展符合全人类的利益。不论AI的未来如何,我们都希望它不仅对AI本身有利,也对人类有益。 最后,我还得提醒一下,他的不少内容是2018年就录好的。对于AI技术,特别是ChatGPT这种东西的出现,vision的重要性远大于tech,因为GPT的原理其实并不比其他的大模型更玄妙,而GPT能先做出来,是因为OpenAI从开始就是瞄准的AGI,然后加上短期内没想着盈利的理想化的做法才做到的。 可以说,vision其实差的很远,而短期内也很难补足。 |

|

肖教授的领域我略了解一点 肖教授本身就是知识图谱的领域的大牛 openai的gpt出来后 知识图谱真是被一锅端了 陆奇甚至说知识图谱已死,做知识图谱就是浪费时间 这背后的是有没有更大的vision的问题 肖教授真有这个vision 应该早年就彻底放弃知识图谱 而是改做语言模型 但是他没有 这点我觉得很有趣 很早之前 我看一个老外说 他要把所有精力都投入语言模型这个意义非凡的领域 但是那时我完全没感受 最近才恍然大悟 看来那老外确实在多年以前就有这个vision了 而那时候 我还在忙着做分类和打标签这种 super没啥深远意义和大的vision的事情 而大多数人也没有这个勇气跳出来 因为“这是微信很重视的事情” “这是xx业务领导拍板要做的” “这是小龙亲自看的事情”等等 所以我觉得这也不是单纯的走捷径的问题 而是应该从一个更大视角来做价值评估的问题 |

|

肖仰华教授:我国长期以来的科研文化是工程师文化,是追赶式跟随式的文化,已经难以适应当下对于原始创新的迫切需求。只有从科研文化源头上找寻问题、解决问题,才能确保我们与OpenAI的差距不被拉大,才能确保在通用人工智能赛道上不掉队。 媒体:懂了,教授说“我们与OpenAI的差距正在拉大”。 复旦教授肖仰华:我们要努力缩小与openai的差距?baijiahao.baidu.com/s?id=1783417660049167416&wfr=spider&for=pc |

|

|

|

|

本来我准备开骂了,说“此人人文素养、科学水平,并不足以支撑其推理起点、推理结论”! 但是想到媒体,不得不找一下出处。发现好些报道都是这样的,还加了引号,让我一度以为就是这样,好在最后发现原始出处(百家号)。 我看了一下,背景是Open AI近期剧震,蓝鲸财经借此对肖仰华进行专访,聊聊AI相关问题。所以蓝鲸财经的官方报道,应该是最原始、最权威材料。 “我们的文化中,聪明人太多,总想抄近路。有时候就是要坚持,要笨一点,才能做出真正的大杀器。我们与OpenAI的差距正在拉大,不是在缩小” 我看了半天,这段话在采访稿中并没有。 本以为事情结束了,官方百家号发布的信息应该是其官方信息。 但是我错了。 原以为天下缺德一石,媒体独占八斗! 查看下官网,感觉大家还是低估媒体缺德程度! 为何? 因为官网上最开始就是上面那段话。 两个官方报道,竟然不一样! 这时候,应该相信官网的报道。 但有个问题,官网报告的,采访提问回答内容,并没有上面那段话。 那么那段话哪里来? 如果是肖的原话,那说明对话采访做了修删,那么报道前因后果及其真实性就… 如果不是肖的原话,那特地加上引号,并置顶,就…… 肖的话真实与否不得而知,媒体缺德程度不言自明。 整个过程,简直一波三折。 蓝鲸财经:复旦教授肖仰华:我们要努力缩小与openai的差距 官网: https://m.lanjinger.com/d/223167?m.lanjinger.com/d/223167 官方百家号 https://baijiahao.baidu.com/s?id=1783417660049167416&wfr=spider&for=pc&searchword=%E5%A4%8D%E6%97%A6%E5%A4%A7%E5%AD%A6%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%A7%91%E5%AD%A6%E6%8A%80%E6%9C%AF%E5%AD%A6%E9%99%A2%E6%95%99%E6%8E%88%E8%A1%A8%E7%A4%BA,%E6%88%91%E4%BB%AC%E4%B8%8EOpenAI%E7%9A%84%E5%B7%AE%E8%B7%9D%E6%AD%A3%E6%8B%89%E5%A4%A7?baijiahao.baidu.com/s?id=1783417660049167416&wfr=spider&for=pc&searchword=%E5%A4%8D%E6%97%A6%E5%A4%A7%E5%AD%A6%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%A7%91%E5%AD%A6%E6%8A%80%E6%9C%AF%E5%AD%A6%E9%99%A2%E6%95%99%E6%8E%88%E8%A1%A8%E7%A4%BA,%E6%88%91%E4%BB%AC%E4%B8%8EOpenAI%E7%9A%84%E5%B7%AE%E8%B7%9D%E6%AD%A3%E6%8B%89%E5%A4%A7 |

|

人家教授明明在说:我们怎么做,才能不被openAI拉大差距,表达了积极的奋斗精神;到了媒体这里,就生生扭曲为:“我们正在被openAI拉大差距“,表达着消极的躺平情绪。 完整看完采访后,我非常认可肖教授的观点,简单解读一下这篇采访。 1,推测OpenAI或许使用了大小模型结合的技术 也被称为混合模型,这的确是大模型发展的一个前沿的领域,让不同的模型解决不同的问题,做自己更擅长的事情,可以有效的提升语言模型整体的处理效率。 2,积极开辟大模型竞争的新赛道,比如医疗大模型、科学大模型等 目前国内有将近200个各类大模型,其中一多半都是垂直行业模型,鞍钢最近就联合众多科研机构提出的钢铁行业大模型。 3,对AI技术的应用需要制定明确的界限和规则 无论中国、美国还是欧洲,都制定了类似的法律。这次openai的宫斗大戏,导火索就是独立董事toner和altman对美国的这项法律的不同态度引起的冲突。 4,要从数据源头治理好数据 决定大模型质量的三要素:数据、算法和算力,我们都是落后的。数据这部分就体现在中文数据相对英文数据来说,质量是比较低的。举个例子,维基百科的内容可以直接用来训练大模型;但是百度百科就不行,因为里面有太多广告,必须经过清洗之后才能用于训练。 5,我们要努力健全国产算力体系,做到国产算力的自主可控 这一条非常重要,目前美国主要就拿两个芯片在卡我们的脖子,一个是cpu,一个是GPU。但是GPU突破的难度相对较小,目前国内已经有50几家GPU的生产厂商,前一段时间百度还下单购买了1000多块华为的GPU。美国把禁止出口中国的GPU标准不断升级,目前弄的英伟达也很难受,一方面中国市场的销量差不多占到英伟达整体销量的20%,另一方面就是中国厂商追赶的速度比较快,如果给他们1-2年的时间,有可能就真把英伟达挤出大陆市场去了。 6,要推动长期主义的原始创新 这一条很对,我们的科研缺乏长期主义,总是希望能投产马上看到效果回报的方向。但是这本身也是有时代局限性的,当我们的资源有限,百废待兴的时候,资源当然会优先倾斜给能马上出成果、出产能的方向。随着资源不断丰富,那些短期出不了成果的方向才有可能逐渐分配资源。 就好比你全身上下就10块钱,那你肯定优先拿来买吃的而不是去看话剧;但是等你钱多了,你就会加大在艺术、哲学方面的投入了。 7,大模型……需要结合场景形成智能应用 这一点基本上是行业共识了,A16Z(openai的天使投资人)就提出AIGC的两次浪潮的观点,第一次浪潮是toc的,第二次就是tob的,也就是具体业务场景下的应用。 8,普通人面对AI要思考自己的价值和意义 这一条也是行业共识了,可以说,AIGC是一种新的生产工具,但是这种生产工具比起以往所有的生产工具对人的影响都要大,都要深远。以前的工具如果说是增强了人的某些能力,那么AIGC就是要替代某些能力,同时催生出某些新的能力。 好了,解读就这么多吧。最后想说说这个问题下最多的两类答案: 第一类是幸灾乐祸的,除了蠢,我实在找不出其他形容词。稍微睁眼看一看,就能知道中国的AI的快速的追赶多么迅速,以至于让美国产生了多么强的危机感、紧迫感。比如上个礼拜,阿里、字节同时发论文,如何让一张照片生成流畅的舞蹈视频,效果十分惊艳。 第二类是危言耸听博眼球的。这是目前很多人对AI领域最大的误解:尽管AI'的确是目前世界上最前沿的科技之一,但是还基本在我们人类可认知的范畴内,远远到不了科幻小说那么玄幻的地步。比如,尽管ilya一直在考虑AI与人类的对齐问题,甚至在去年就发过推特,说他觉得人工智能有“轻微的自主意识”。但是这个所谓的意志,和科幻小说了里人工智能突然觉醒,决定消灭人类的那种意志根本说的不是一回事儿。 简单说,你问chatgpt3+2等于几,他之所以会说等于五。是因为他的庞大语料库里,有大量的关于3+2=5的资料,所以5是一个正确概率最高的答案。这就叫“没有意识”。好比有个小孩子,根本不会算算数,但是你每天就跟他说3+2=5、3+2=5,有一天你问他3+2=几?他就会说等于5. 而ilya说的“轻微意识”,也是目前openai内部被曝光的一个研究方向(Q-star),就是让AI理解3+2到底是什么意思,如果一旦他能理解了,那即使没有语料库,他也能得出正确的答案,甚至能自己生产语料库。 总之,AI是一项先进技术,并没有很多人想的那么神秘,他还处在可以理解、可以控制的程度上。 |

|

一堆坐在马车里的大老爷还在想怎么制定马拉火车的标准,你被正经的火车拉开差距不是非常正常的事情吗? |

|

那确实,毕竟全世界都找不出这么多张嘴抄袭闭嘴套壳的AI懂王… |

|

ai 不先进,实在是一件幸事,否则美丽新世界真的回来临,高科技牢房的来临会大大延迟,每人配个智能守卫短期不会实现。 这世界真的设计的很精妙,当你试图控制他人的思维,那么就很难有创新的成果或伟大的发现,从而无法实现超级 ai,也就无法完美的控制。 如同满清通过落后封闭控制大清,最后却因为落后而被先进爆锤,天理循环,总归要还的。 |

|

很多人说美国打压芯片利好芯片产业,强行逼迫自研。这句话是对的,因为美国打压芯片出口目标不是你芯片产业。 打光刻机利好光刻机,利空芯片产业。因为中芯工艺不能再往上升要等光刻机先出来。 打压ai芯片利好芯片产业,利空ai。 这不明摆着吗 |

|

真复旦,真教授,还没有被浊水同化。 |

|

|

|

|

“我们的文化中,聪明人太多,总想抄近路”不是严肃的分析,而是毫无意义的文化批判。 不过大语言模型这个领域,确实是打破了那些超越神话。 chatGPT是2022年12月出来的,到现在都要满一年了。当时信誓旦旦半年到一年就能赶超的人,不知道现在脸红不红。到现在为止,没看到有一个和GPT 3.5 Turbo能力等同的,更不用说GPT 4了。现在事实就是GPT 4和Claude 2领先程度很高。 你如果再回过去看2023年初,有些人说大语言模型是大力出奇迹,成本高到根本没法用,是奇观式科技创新的。现在回过头来看更是错得离谱。OpenAI都官宣周活跃用户超过一个亿了。他们当时都是拿着GPT 3 API价格当成本,是基于错误的成本数据进行估算。 实质上,大语言模型上的“落后”就是各家APP搞封闭化的恶果。本来是公开网站资源,爬虫就可以的事情。现在是微信公众号拒绝搜索引擎的索引。 把一个完整的内容切片成不同的块块,然后做不出高质量的大语言模型。这就是德行匹配的下场。 公众号内容谷歌能搜到!微信回应:是漏洞,目前已修复?baijiahao.baidu.com/s?id=1714311133911968325&wfr=spider&for=pc |

|

离谱的是别人在创新,而我们在抄袭。 更离谱的是抄袭的速度还跟不上别人创新的速度。 |

|

题主是怎么理解出这段话的? 肖老师的原话是三点。 一是要搞数据,这也是国内大模型的共识,大家都没有去试新的模型结构,都是在数据上下功夫。这里并不存在什么聪明和笨。不会真有人觉得设计数据处理流水线比设计模型结构需要的智力更少吧?只不过搞数据肯定更脏更累,而在标准化的数据集下搞模型就相对没那么脏。 二是要搞算力。 三是要搞长期主义,要容忍失败。而这恰恰就是在支持像ilya和alec这样的聪明人用他们强大的洞察力和视野抄近路、搞弯道超车。如果只是跟着走直道,追一点就是一点,不需要长期,也不容易失败。 事实上OpenAI就是弯道超车的典范,Google是Transformer的提出者,也一直在深耕Encoder-Decoder和PrefixLM架构,工程优化支持大规模训练的能力更是冠绝世界,为什么在OpenAI面前几乎是一败涂地?就是因为Google在数据处理上的投入不够,也没有全力搞自回归语言模型+仅Decoder+所有任务大一统。OpenAI坚定地搞大一统,就决定了他们要搞自回归语言模型(尽管PrefixLM也可以),就决定了他们要搞RLHF而不是逐任务微调。 蓝鲸财经: 您认为中国在AI领域的发展和突破的难点是什么? 肖仰华: 当前,我国在AI领域的原始创新能力仍然有待进一步提高。具体到大模型方面,我们并未能在国际上率先推出最为先进的大语言模型。虽然国内很多企业投入了巨大研发资源,我们的大模型也能在某些评测数据或评测指标上接近甚至超过GPT4。但是总体而言,其综合能力仍与GPT4存在明显差距。智能从本质上来讲是一种综合能力,再多的单项指标超越也难以宣示对于对手的绝对领先。国产大模型必须踏踏实实炼制好自己的大模型,从数据源头治理好数据。大模型本质上是工程创新,要多做数据方面的脏活、累活、苦活、细活,才有可能炼制出领先水平的大模型。大模型的效果取决于能否把工程细节做得足够细致、足够深入。一味地追求模型方面的巧活可能会浪费大模型追赶的宝贵时间。 同时,我们要努力健全国产算力体系,做到国产算力的自主可控。西方的领先算力很容易被限制,必须大力发展国产算力,比如华为的晟腾系列。国产算力仍需时间耐心地培育市场和生态体系,才能建立健全包含芯片、设备、软件在内,涉及开发者与使用者的完整生态。当前,西方不断提升对于我国高端算力的禁运力度,在此形势下,发展国产高端算力成为了唯一路径,相信国产算力很快就能赶上。除了算力,高质量训练语料的汇聚与治理问题也是完善大模型发展生态不可缺的重要一环。 提升我国人工智能的原始创能力可能还要从科研文化这个根本问题上着手解决。要推动长期主义的原始创新。短频快式的科研文化难以胜任原始创新。以大语言模型为代表的通用人工智能本质上也是OpenAI这类企业长期坚持的结果。OpenAI从18年GPT第一个版本发布开始,直到2022年底推出ChatGPT才一鸣惊人,大获成功,进而引起从学术界到工业界的广泛关注,才成就了AGI(通用人工智能)的Iphone时刻。在其漫长的探索过程中,要对错误、失败有着高度的容忍,要对未来保持高度的自信,要对科研的试错报以足够的耐心。这样一种长期主义科研文化是我们当下所缺失的。我国长期以来的科研文化是工程师文化,是追赶式跟随式的文化,已经难以适应当下对于原始创新的迫切需求。只有从科研文化源头上找寻问题、解决问题,才能确保我们与OpenAI的差距不被拉大,才能确保在通用人工智能赛道上不掉队。 |

|

问题我们都知道,所以,他给出了什么样的解决方案? |

|

这是15年开始的网络净化行动就注定了的 |

|

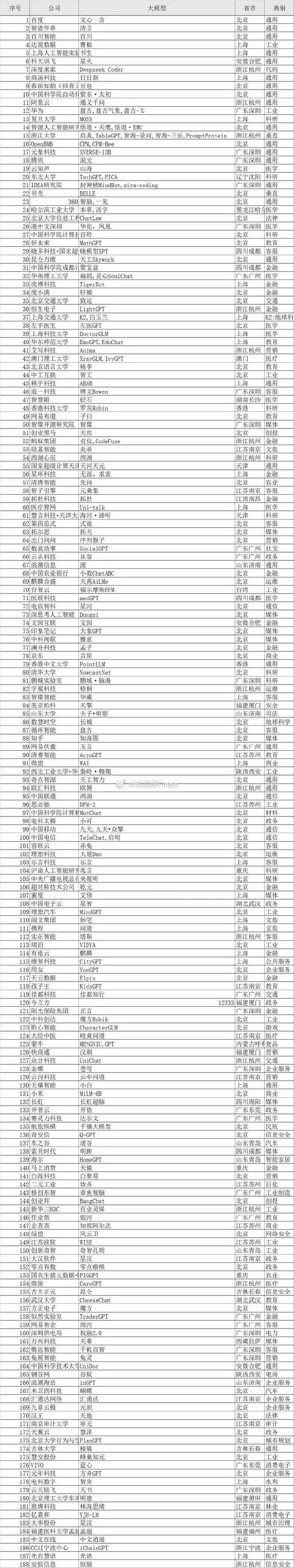

omg,omg,终于排到我了,你们知道国产大模型有多少个了吗??188个!一百八十八个!!!可谓是遥遥领先... |

|

|

|

|

国内所有的文本大模型团队的骨子里就没有AI的气息,呼出的口气都是套壳的气息,没有一个团队的创始人是AI专业出来的,与OpenAI的团队人员构成对比一下就知道了,根本就没有大模型的基因,全是跟风抄袭出来的,自己根本没有跑出流量,全部依赖过去的流量套壳搞一波,从自己的右边口袋把流量导到左边的口袋,这种AI创业本质和AI的创业环境本质就是个笑话。 这次重大的差距象什么呢?象国产火箭和马斯克的可回收火箭,基因全面错误,战术全面错误。更搞笑和诡异的是大模型居然要通过发牌照才能创业,这就是导致大量的创业团队全面死亡,有技术实力的人要么加入大公司(获得牌照)做底层打工人,要么出国加入欧美一线团队,顶尖人才没有拿到大模型牌照的就已经失去创业机会了,错失了优秀的AI基因人才,这种人才必然外流,不走出去连请客喝酒的钱都没有。没有OpenAI级别的土壤,拿到大模型牌照的公司也不会老老实实去搞大模型,就想着拿牌照和开源项目套甲方的钱,套国家补贴的钱,根本就不会老老实实创业了,因为牌照本身就是稀缺资源,既然已经是稀缺资源了,为什么还要老老实实赚那些掉头发都不一定赚钱的项目呢? 拿到牌照的公司没有一个不是最聪明的公司,但是有一家是踏踏实实搞技术的吗?说良心话是开始就踏踏实实搞技术的吗?并不是吧,放眼看上去都是商务能力大于技术能力的公司,这就是说国内的大模型市场必然回归喝酒、请客、送礼、吃回扣的悲惨结界,这种结界内怎么可能会酝酿出比肩OpenAI的团队和公司呢?不可能的,永远不可能,行政命令大于创新的地域怎么可能会孕育出OpenAI呢? 1、基因错误 2、人才外流 3、政策封闭 4、全在骗,风投也不敢投。 5、环境恶劣 6、很难出现顶尖的人才和团队,有也跑了。 7、不踏实 现在的差距象什么呢? 头部企业有能力的太多但是没有一家踏实做的,想踏实做的创业者没有钱,有钱有技术能力的没牌照,怎么做都是死局还做个屁啊? |

|

难得有说大实话的教授,我们这都啥,自己没操作系统,用AOSP改个鸿蒙吹了几年,已经是国产之光了都… |

|

不知道国内搞大模型的公司、机构和大学,使用的语料有多少“不合时宜”、“重复无感”的内容? 全世界主流的大模型训练语料中,中文信息占比也就百分之几,无他,内容太少,实在少的可怜 以前还记得有人吐槽国内互联网的内容在不断枯竭, 不止如此,还是一个个孤岛,信息不互通,说个不好听的,国内和国外哪边的有效中文语料丰富还真不一定呢 当然我国也可以去用英语语料训练,问题是你有那么多的数据来源吗? 如果只是谈算法,我相信我国那么多聪明的脑袋,不是问题, 但人工智能的另外两根柱子,大数据和芯片呢? |

|

|

| [收藏本文] 【下载本文】 |

| 上一篇文章 下一篇文章 查看所有文章 |

|

|

|

|

古典名著

名著精选

外国名著

儿童童话

武侠小说

名人传记

学习励志

诗词散文

经典故事

其它杂谈

小说文学 恐怖推理 感情生活 瓶邪 原创小说 小说 故事 鬼故事 微小说 文学 耽美 师生 内向 成功 潇湘溪苑 旧巷笙歌 花千骨 剑来 万相之王 深空彼岸 浅浅寂寞 yy小说吧 穿越小说 校园小说 武侠小说 言情小说 玄幻小说 经典语录 三国演义 西游记 红楼梦 水浒传 古诗 易经 后宫 鼠猫 美文 坏蛋 对联 读后感 文字吧 武动乾坤 遮天 凡人修仙传 吞噬星空 盗墓笔记 斗破苍穹 绝世唐门 龙王传说 诛仙 庶女有毒 哈利波特 雪中悍刀行 知否知否应是绿肥红瘦 极品家丁 龙族 玄界之门 莽荒纪 全职高手 心理罪 校花的贴身高手 美人为馅 三体 我欲封天 少年王 旧巷笙歌 花千骨 剑来 万相之王 深空彼岸 天阿降临 重生唐三 最强狂兵 邻家天使大人把我变成废人这事 顶级弃少 大奉打更人 剑道第一仙 一剑独尊 剑仙在此 渡劫之王 第九特区 不败战神 星门 圣墟 |

|

|

| 网站联系: qq:121756557 email:121756557@qq.com |